| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | 4 | 5 | 6 | |

| 7 | 8 | 9 | 10 | 11 | 12 | 13 |

| 14 | 15 | 16 | 17 | 18 | 19 | 20 |

| 21 | 22 | 23 | 24 | 25 | 26 | 27 |

| 28 | 29 | 30 |

- 감정은 습관이다

- ifnull

- LAG

- 데이터 분석

- sorted

- 비지도학습

- SQL

- CASE WHEN

- DecisionTree

- five lines challenge

- beautifulsoup

- recall

- NVL

- 데이터 전처리

- Normalization

- 지도학습

- 재현율

- nvl2

- 백엔드

- 강화학습

- Batch Normalization

- 데이터 프로젝트

- 결정트리

- NULLIF

- 빠르게 실패하기

- 평가 지표

- 웹서비스 기획

- 오차 행렬

- 정밀도

- layer normalization

- Today

- Total

목록전체 글 (62)

Day to_day

GoogleNet (InceptionNet) 빠르게 핵심만!

GoogleNet (InceptionNet) 빠르게 핵심만!

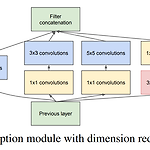

들어가며 VGG를 알아봤으니 GoogleNet도 빼먹을 수가 없다. 빠르게 정리하고 넘어가 보도록 하겠다! 이 내용은 혁펜하임님의 Legend 13 강의를 재구성 한 것입니다. GoogleNet 특징 일단 특징을 먼저 정리하면서 기억해야 할 것을 위주로 정리해 봤다. 여러 크기의 필터를 사용 VGGNet 3x3 필터를 두 번 통과시켜 5x5 필터와 같은 receptive field를 얻은 반면, Inception Net은 여러 사이즈의 conv layer를 통화시키면서 입력 이미지에 대해서 서로 다른 크기의 패턴 및 특징을 캡처할 수 있도록 돕는 역할을 했다. 각 레이어를 병렬로 연결 여러 필터에서 얻은 feature map을 depth 방향으로 concatenate를 시켰다. 그러면서 다양한 추상화 수..

VGGNet 아직도 정리 못했다면 빠르게 핵심만!

VGGNet 아직도 정리 못했다면 빠르게 핵심만!

들어가며 너무나도 유명한 VGGNet을 읽어보면서 짧게 정리하고 넘어가는 포스팅을 작성하려고 한다. 이 글을 읽기 전에 컨볼루션 layer이 기본적으로 어떻게 동작하는지, pooling, stride, padding에 대한 개념을 알고 VGGNet을 읽어보는 것이 좋을 것 같다. VGGNet 이 연구에서 강조하는 점은 대규모 이미지 인식 환경에서 합성곱 신경망의 깊이가 정확도에 미치는 영향이다. 특히 VGGNet에서는 작은 컨볼루션 필터(3x3)를 사용하여 깊이를 증가시킨 모델이다. VGGNet은 옥스포드 대학의 연구팀 VGG에 의해 개발된 모델로써, 2014년 ImageNet 이미지 인식 대회에서 준우승을 했다. 특히 이 모델은 2013년 8개의 layer에 불과했던 ZFNet 모델에 비해 16, 19..

CBOW & Skip gram 개념 완벽 이해하기!!

CBOW & Skip gram 개념 완벽 이해하기!!

❗본 포스팅은 사이토 고키 저자의 '밑바닥부터 시작하는 딥러닝 2' 서적을 기반으로 개인적인 정리 목적 하에 재구성하여 작성된 글입니다. 들어가며 오늘은 word2vec의 두 가지 기법인 CBOW와 Skip-gram에 대해서 개념을 정리해 볼 것이다. Word2Vec 들어가기전에! 단어를 표현하는 방법 두 가지 개념을 미리 알고 오면 좋다. 1. 희소표현(Sparse Representation) 단어를 원-핫 인코딩을 통해 원-핫 벡터로 표현해 행렬의 대부분 값이 0으로 표현되는 방법이다. 이 방법은 벡터 간 유사성을 표현할 수 없으며 단어가 많아질수록 더 커진다는 단점이 있다. 2. 분산 표현(Distributed Representation) 색을 표현할 때에도 RGB 값으로 모든 색을 표현할 수 있듯..

[논문 리뷰] A ConvNet for the 2020s

[논문 리뷰] A ConvNet for the 2020s

들어가며 ViT모델을 시작으로 Vision Task에 적용된 여러 Transformer 기반의 모델이 많이 나왔다. ConvNeXt 논문에서는 Standard ResNet의 디자인 방향을 점진적으로 modernize 시키면서 그 과정에서 모델 성능에 기여하는 여러 핵심 요소에 대해서 알아볼 예정이다. 다시 말하자면, Transformer의 Design Decision이 ConvNet의 성능에 어떤 영향을 미치는지에 대해 중점적으로 다루고 하나씩 바꿔가며 성능과 연산량 결과를 살펴볼 것이다. 특히 이 논문에서 저자가 강조하고 싶은 점은 많은 Transformer기반의 비전 모델이 나왔음에도 불구하고 "ConvNet 기반의 모델도 잘 디자인하면 좋은 성능을 충분히 낸다"는 것이다. 더불어 이 논문을 통해 컨..

Batch Normalization, Layer Normalization 비교

Batch Normalization, Layer Normalization 비교

들어가며 Batch Normalization은 익히 들어 잘 알고 있었지만 Layer Normalization과 비교해서 개념적으로 어떻게 다른지, 그리고 왜 사용하는지에 대해서 깊게 생각해 본 적이 없는 것 같다. 그래서 먼저 Normalization에 대해 알아보고, Batch Normalization과 Layer Normalization에 대해 알아볼 것이다. Normalization 입력 데이터의 분포를 조정하거나 표준화하여 학습의 성능을 향상시키는 기술이다. 예를 들어 정규화 방법 중 하나인 데이터 표준화(Standardization)는 데이터를 평균과 표준 편차를 이용하여 정규 분포를 만들 수 있다. 그것을 식으로 나타내보자. $$ \hat{x}^{(k)}= \frac {x^{(k)}-E[x^..

[논문 리뷰] CMT: Convolutional Neural Networks Meet Vision Transformers

[논문 리뷰] CMT: Convolutional Neural Networks Meet Vision Transformers

들어가며 Vision Trasformer 이후 더 발전된 Vision 분야에서 Transformer를 활용한 모델을 리뷰하고 있다. 이번엔 어떤 식으로 Vision Transformer의 한계를 해결했는지 궁금해진다. 오늘 리뷰할 논문은 CNN과 Transformer를 결합한 하이브리드 모델을 살펴보고자 한다. CMT에서 알고 가야 할 점! CMT는 transformer base의 CNN을 결합한 hybrid network이다. Transformer의 장점인 멀리 떨어진 range 의존성에 대해서 포착하고, CNN의 local information 추출하는 것이 CMT의 강점이다. CNN과 비교한 비전 트랜스포머의 문제 CNN대비 트랜스포머 기반 비전 모델의 성능이 떨어지는 이유 이미지는 트랜스포머 기반..